基于图卷积网络的图深度学习

本文共 1236 字,大约阅读时间需要 4 分钟。

更多深度文章,请关注云计算频道:

基于图卷积网络的图深度学习

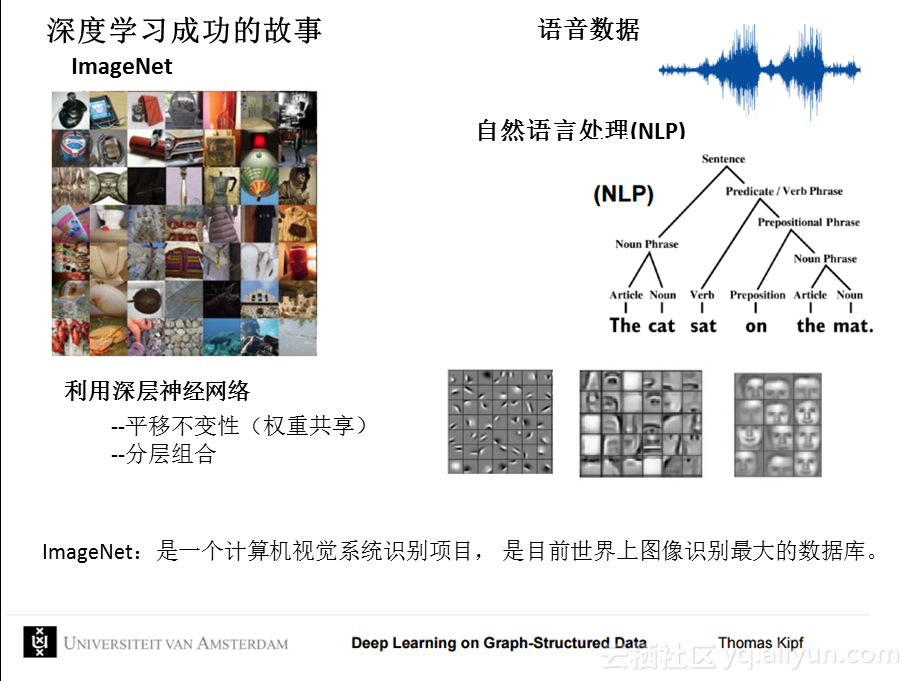

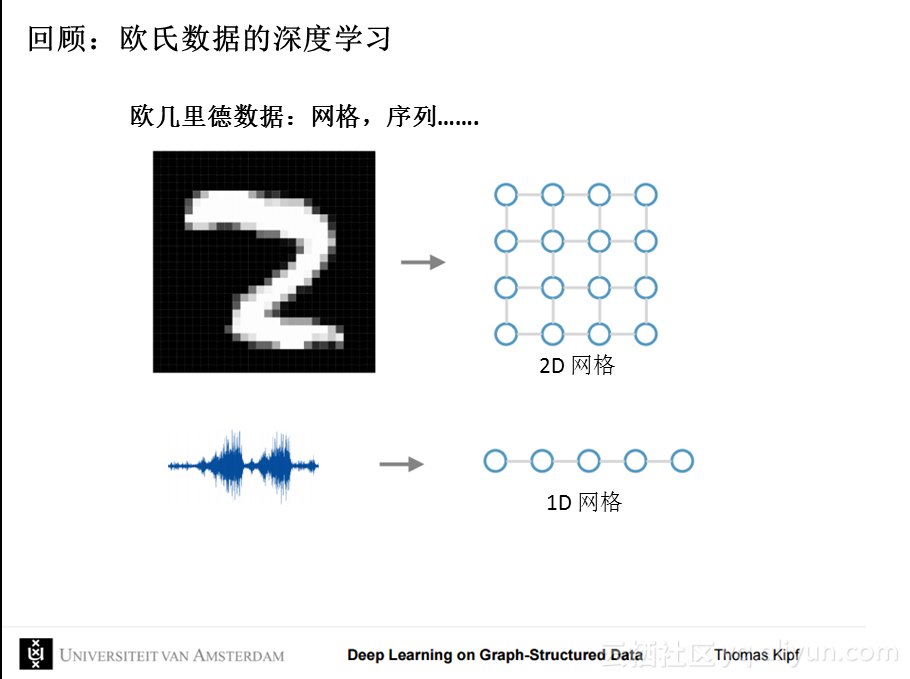

深度学习近些年在语音识别,图片识别,自然语音处理等领域可谓是屡建奇功。ImageNet:是一个计算机视觉系统识别项目, 是目前世界上图像识别最大的数据库,并且被业界熟知。我们先回顾一下,没有大数据支撑的欧式深度学习技术。对于一个字母“Z”的识别,我们通常是建立一个2D网格(点阵),如果将其中的点连接起来,定义这样的连接方式所形成的就是“Z”。然后是用其他字母来测试,这个模型的正确性。

深度学习近些年在语音识别,图片识别,自然语音处理等领域可谓是屡建奇功。ImageNet:是一个计算机视觉系统识别项目, 是目前世界上图像识别最大的数据库,并且被业界熟知。我们先回顾一下,没有大数据支撑的欧式深度学习技术。对于一个字母“Z”的识别,我们通常是建立一个2D网格(点阵),如果将其中的点连接起来,定义这样的连接方式所形成的就是“Z”。然后是用其他字母来测试,这个模型的正确性。

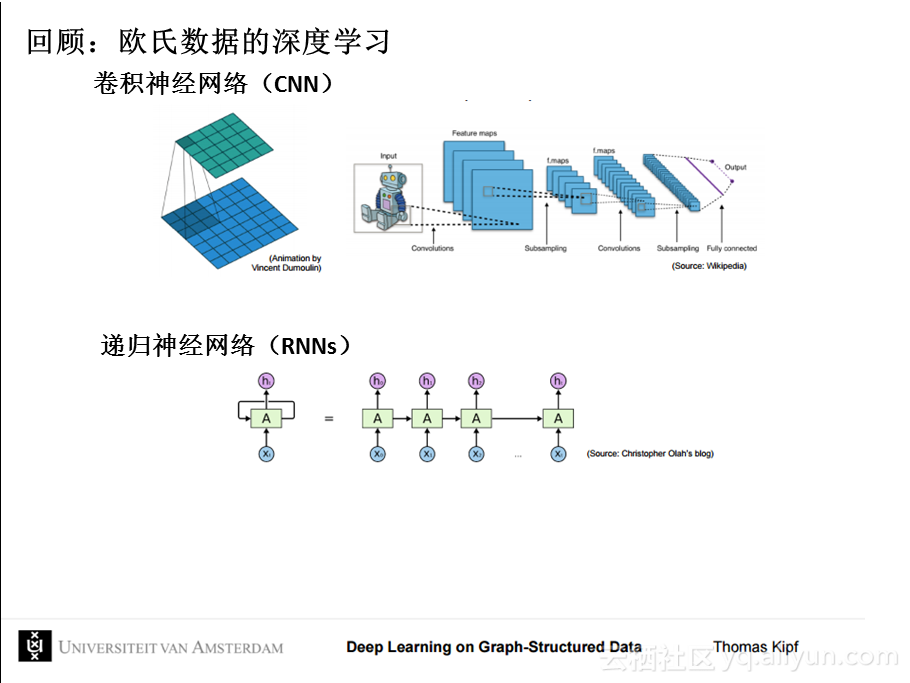

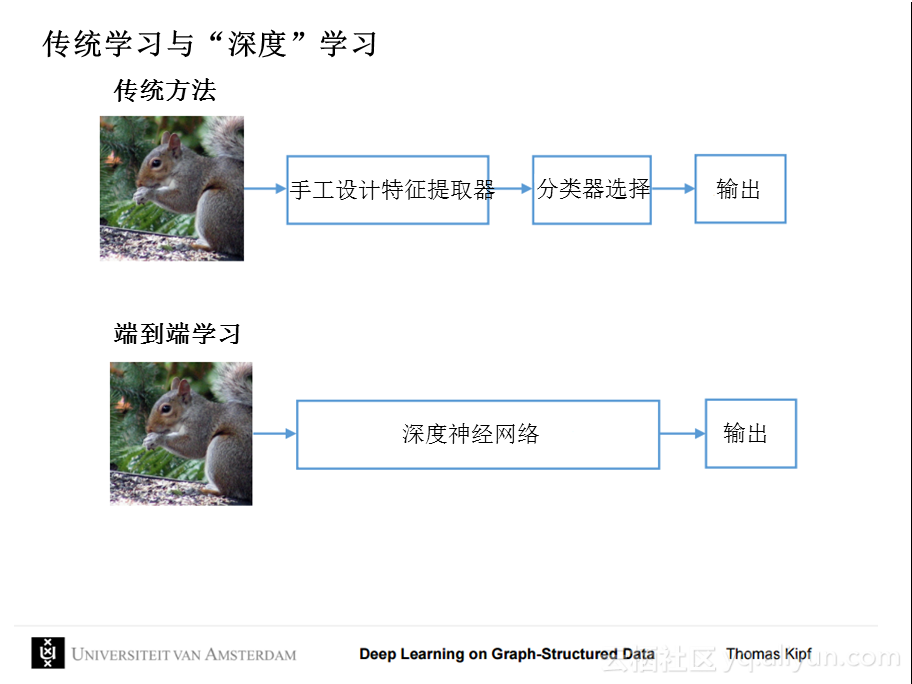

传统深度学习的方法,实际上就是一种手工设计特征的过程。而且,在准确率上没有保障。而真正的深度学习,端到端的学习,其中的过程到底发生了什么,设计者什么也不知道,自然也不会人为的去干涉。

传统深度学习的方法,实际上就是一种手工设计特征的过程。而且,在准确率上没有保障。而真正的深度学习,端到端的学习,其中的过程到底发生了什么,设计者什么也不知道,自然也不会人为的去干涉。

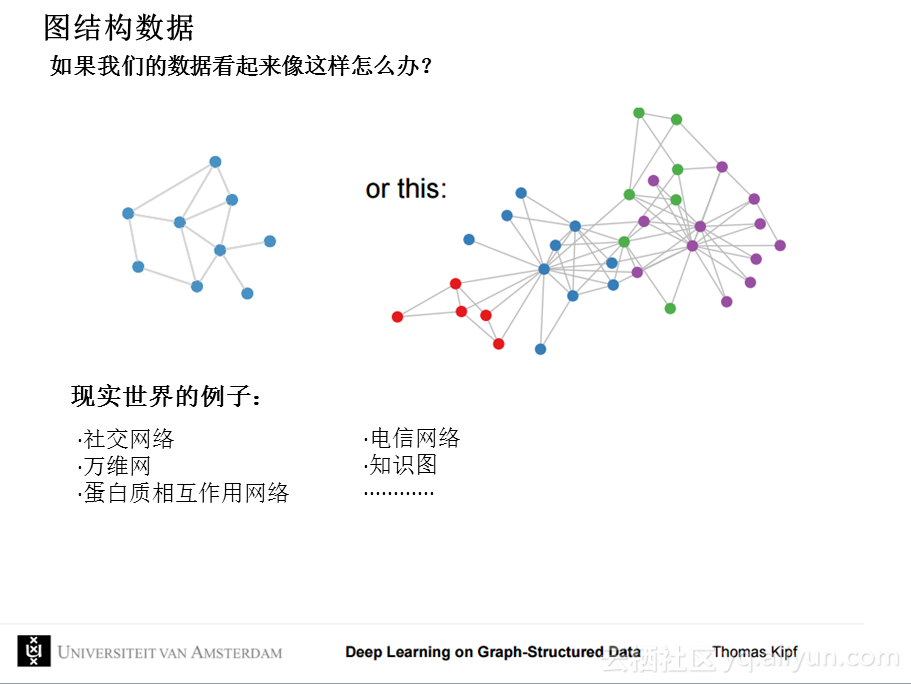

如果数据不能网格化,那么CNNs就失去了作用。所以,CNNs在一定程度上还是有很多缺陷的。例如图结构数据,如何处理?在现实世界中这样的例子很多很多:社交网络(著名的六度理论),万维网,知识图,等等这些都是图结构,不是网格结构,对于这些我们该怎么解决。

如果数据不能网格化,那么CNNs就失去了作用。所以,CNNs在一定程度上还是有很多缺陷的。例如图结构数据,如何处理?在现实世界中这样的例子很多很多:社交网络(著名的六度理论),万维网,知识图,等等这些都是图结构,不是网格结构,对于这些我们该怎么解决。

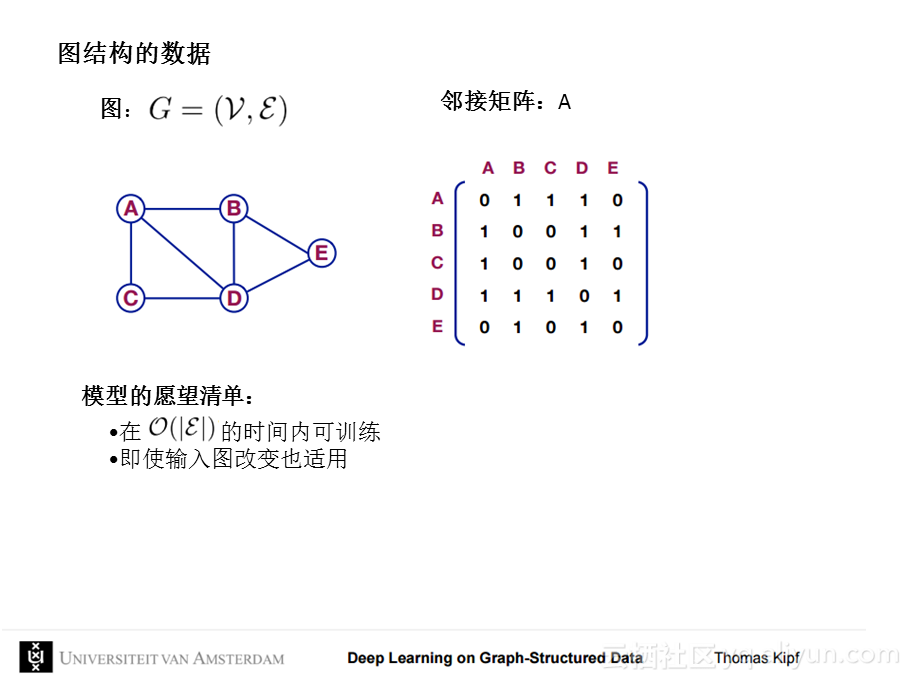

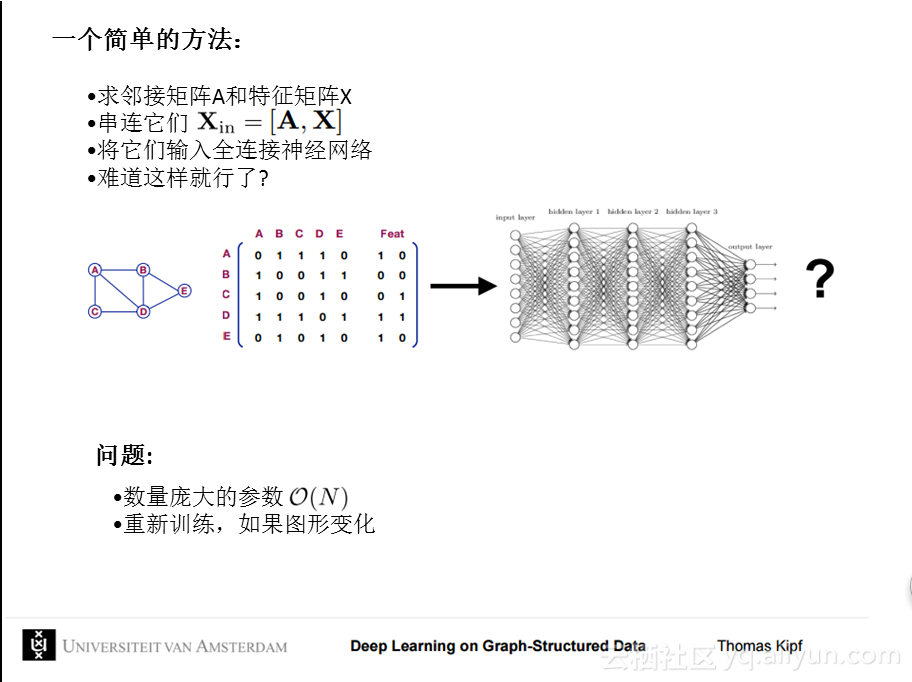

下面是一个简单的解决图结构数据的方法。

下面是一个简单的解决图结构数据的方法。

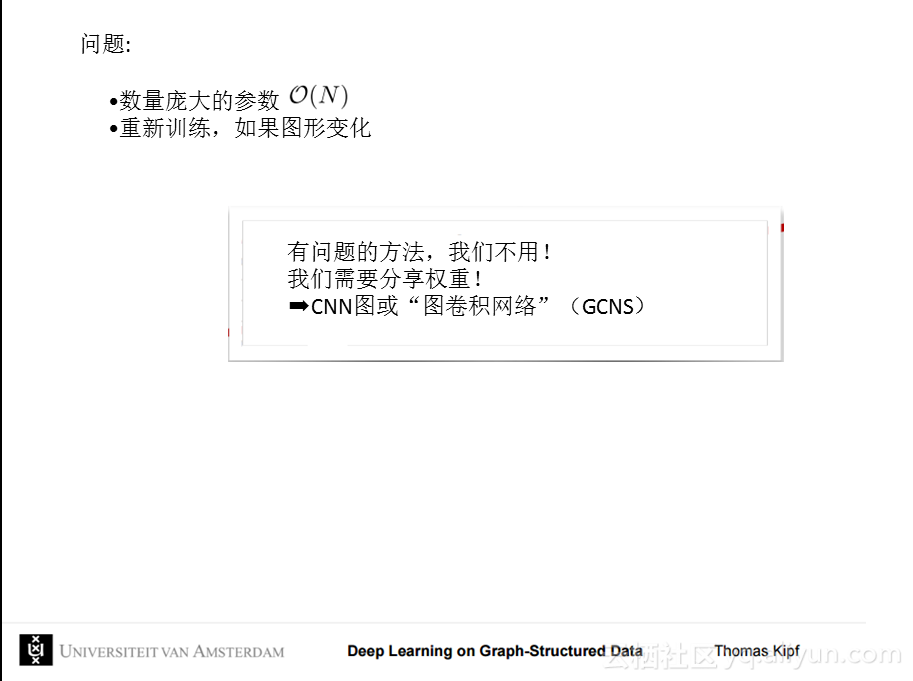

这个方法到底会出现什么样的问题呢?为了解决问题,我们需要什么呢?

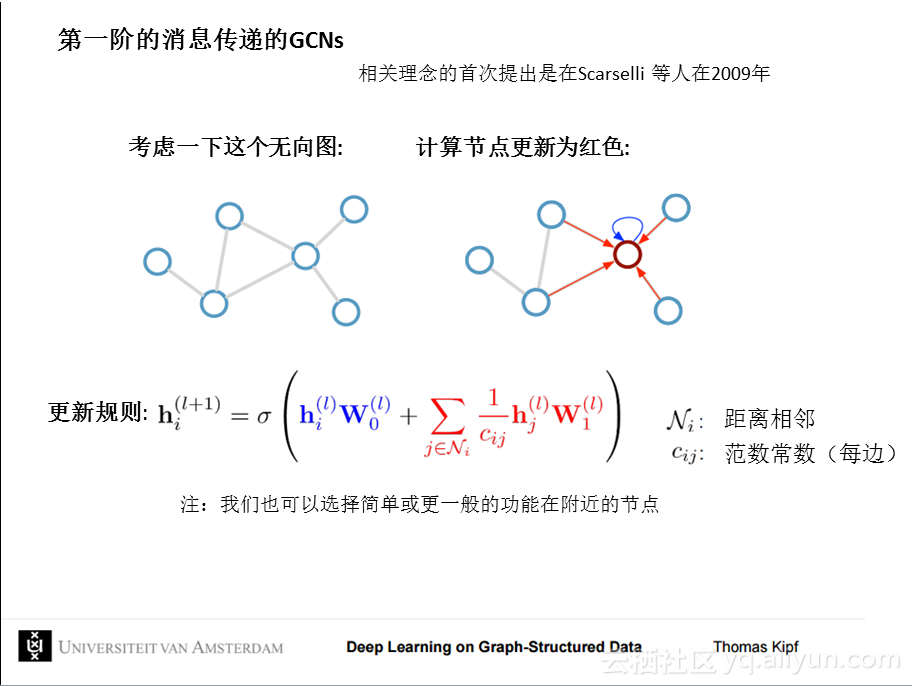

先简单介绍一下第一阶消息传递的GCNs,这个理论在2009年就已经被提出来了。

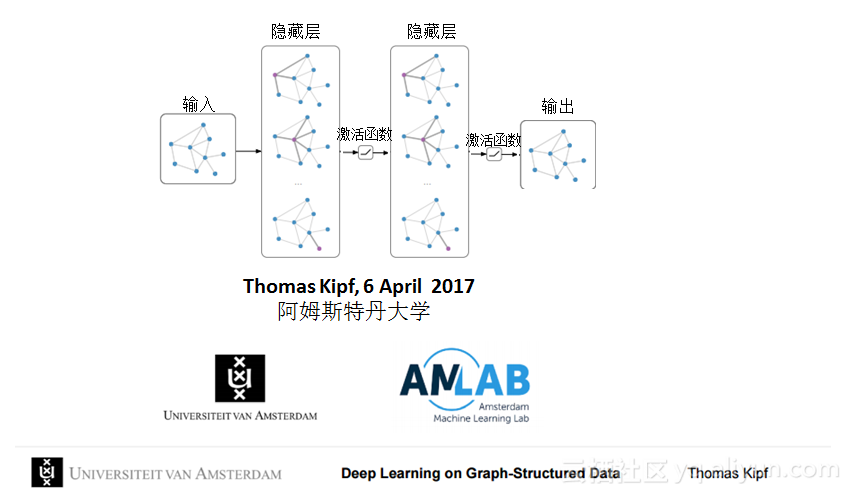

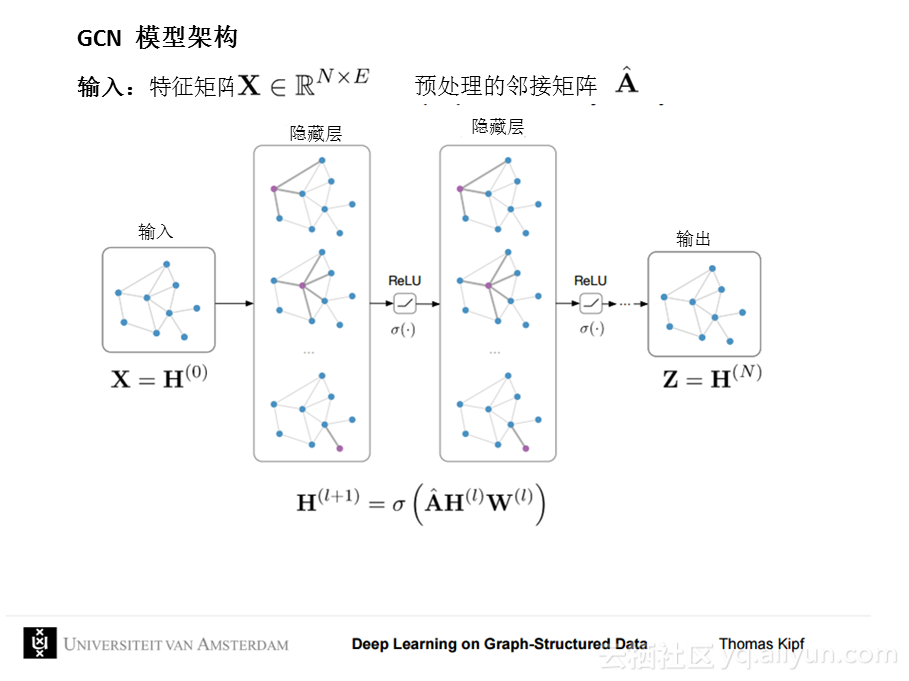

先简单介绍一下第一阶消息传递的GCNs,这个理论在2009年就已经被提出来了。 接下来,我们了解一下GCN模型架构!

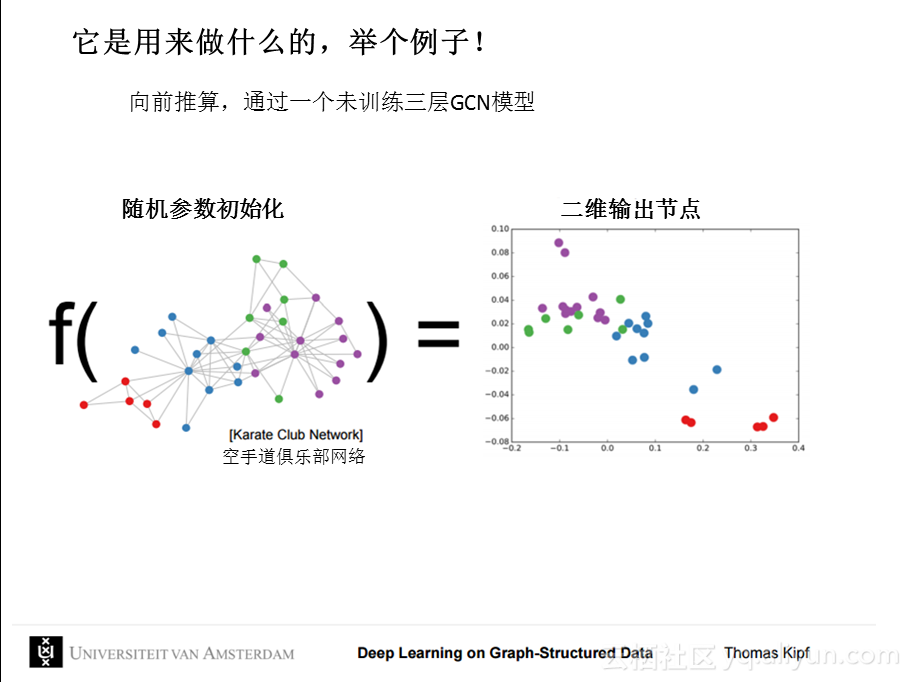

接下来,我们了解一下GCN模型架构! GCN模型架构到底能干什么呢?先举个小栗子。

GCN模型架构到底能干什么呢?先举个小栗子。 GCN模型与大名鼎鼎魏勒雷曼算法的关系到底是什么样的呢?

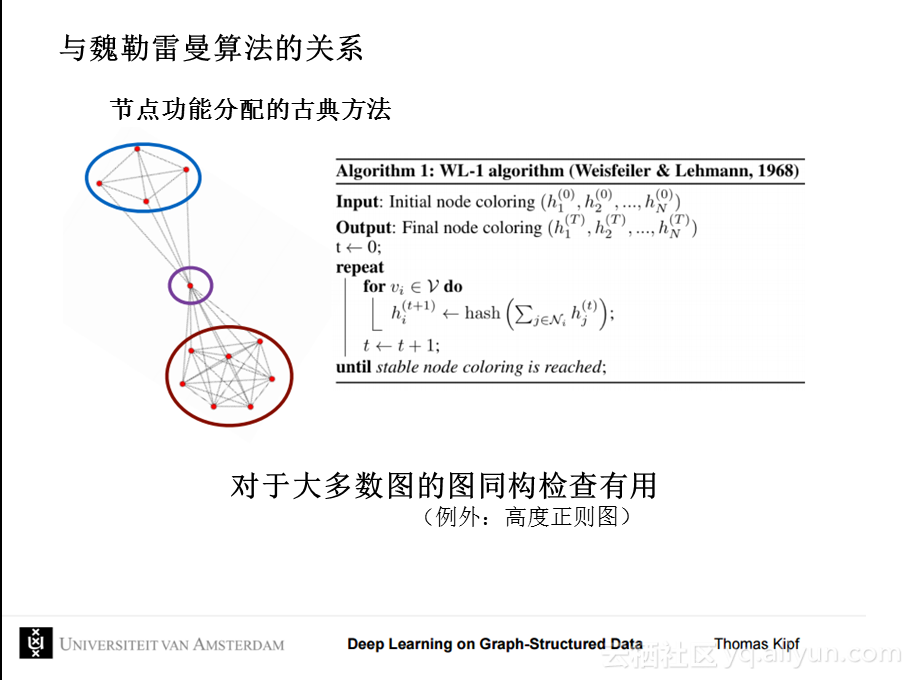

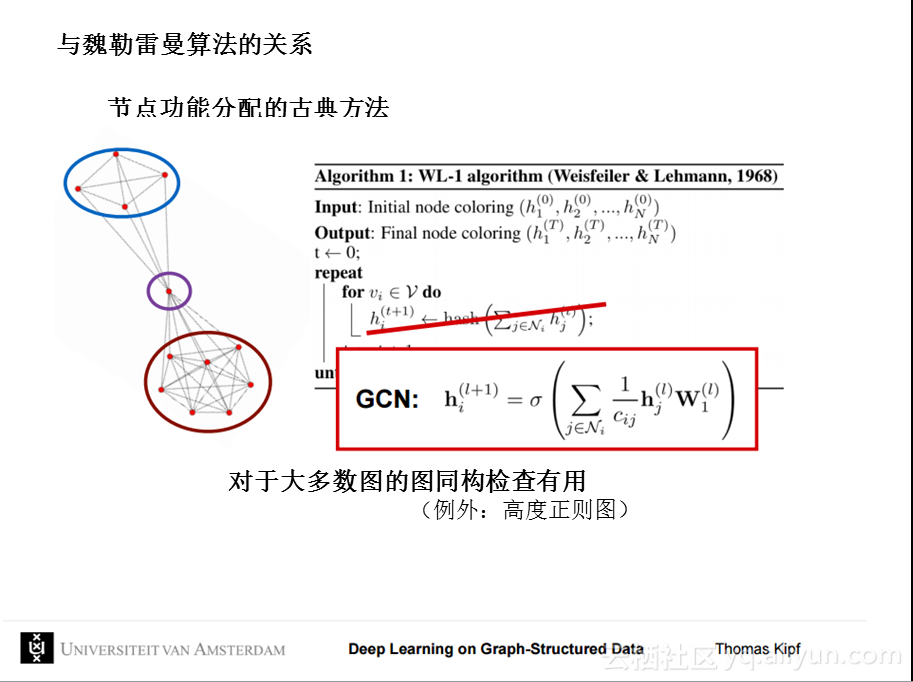

GCN模型与大名鼎鼎魏勒雷曼算法的关系到底是什么样的呢?

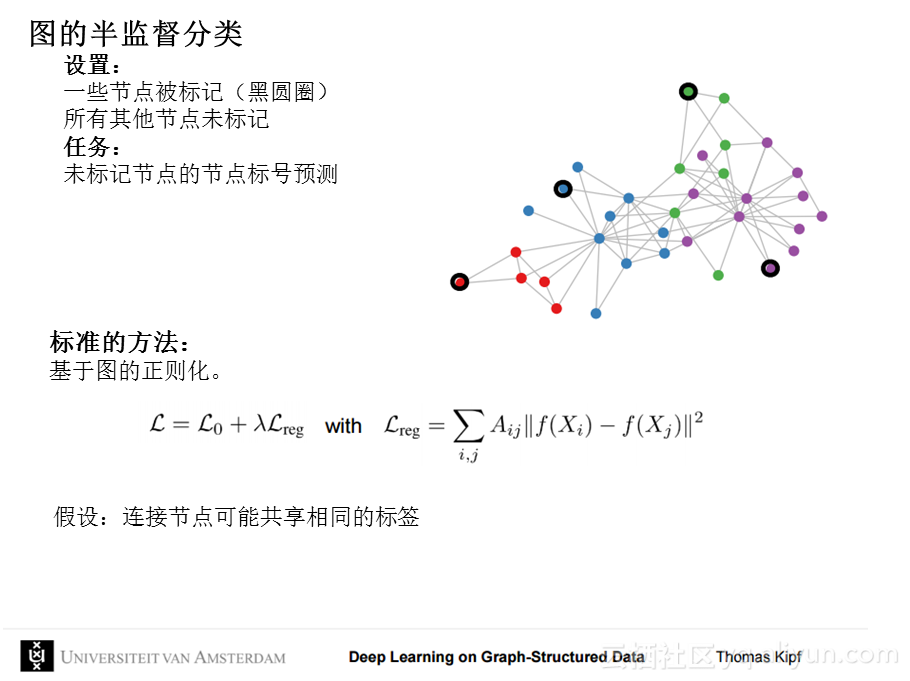

图的半监督分类也是一种不错的方法。

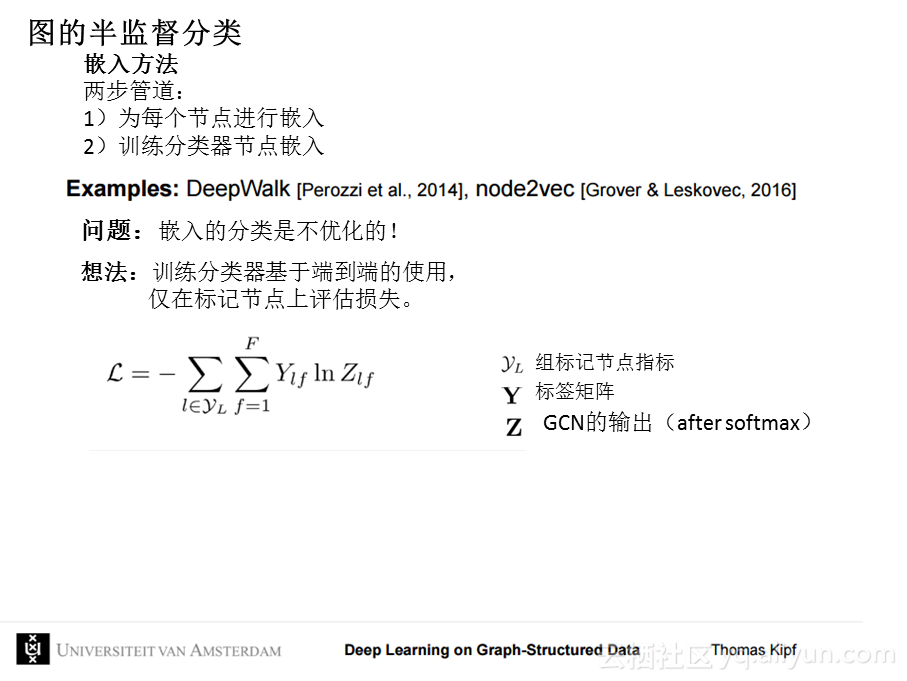

图的半监督分类也是一种不错的方法。 半监督分类嵌入方法——两步管道,这个方法也有一些问题,但我想这是可以解决的。

半监督分类嵌入方法——两步管道,这个方法也有一些问题,但我想这是可以解决的。

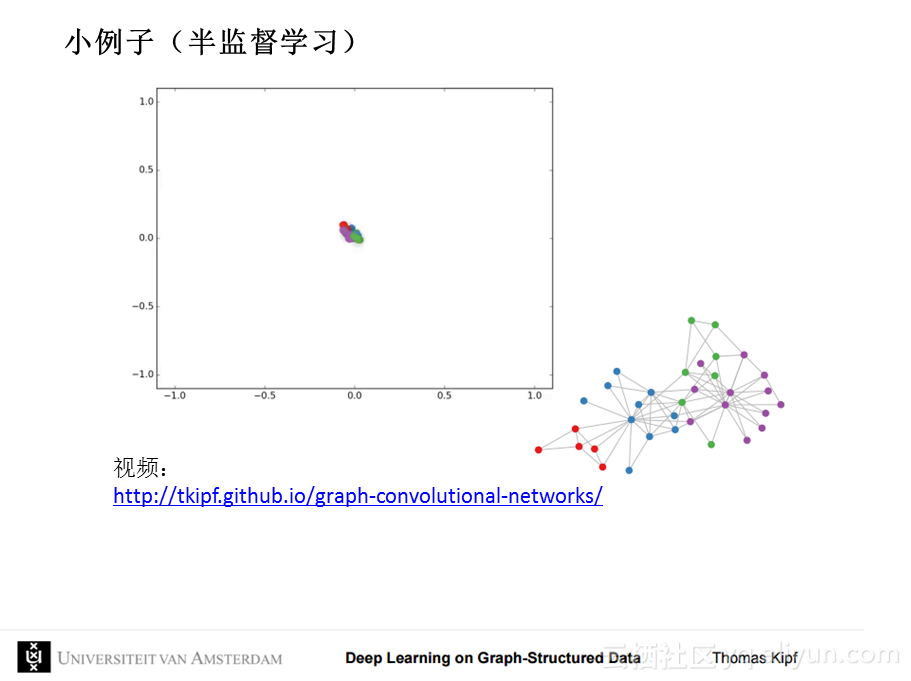

举个小栗子,视频链接是一个关于半监督学习的小例子,有兴趣的朋友可以去看一下。

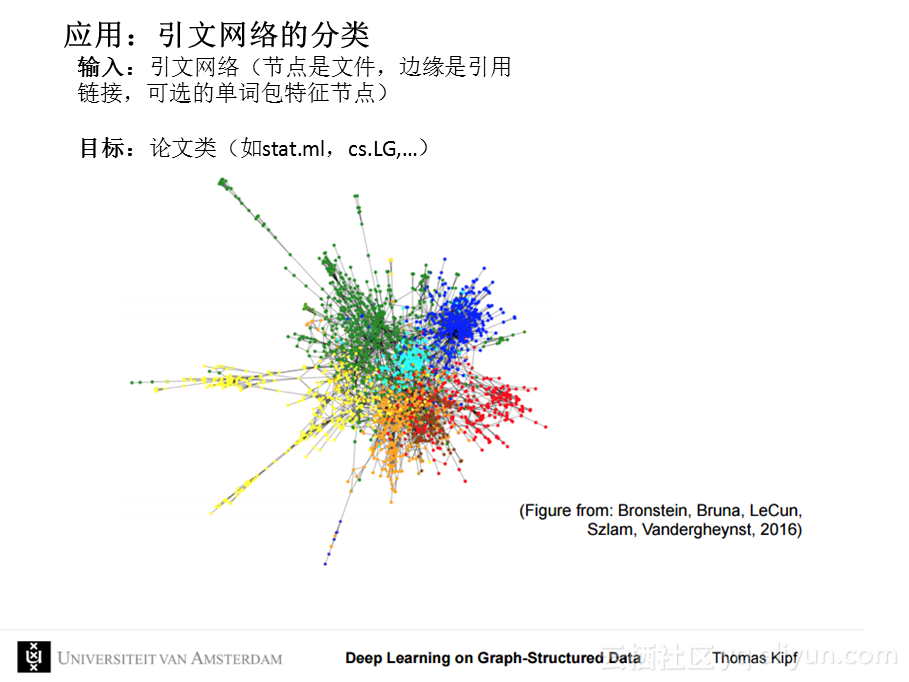

视频:此外,还有关于引文网络的分类,也可以 通过这个方法实现。

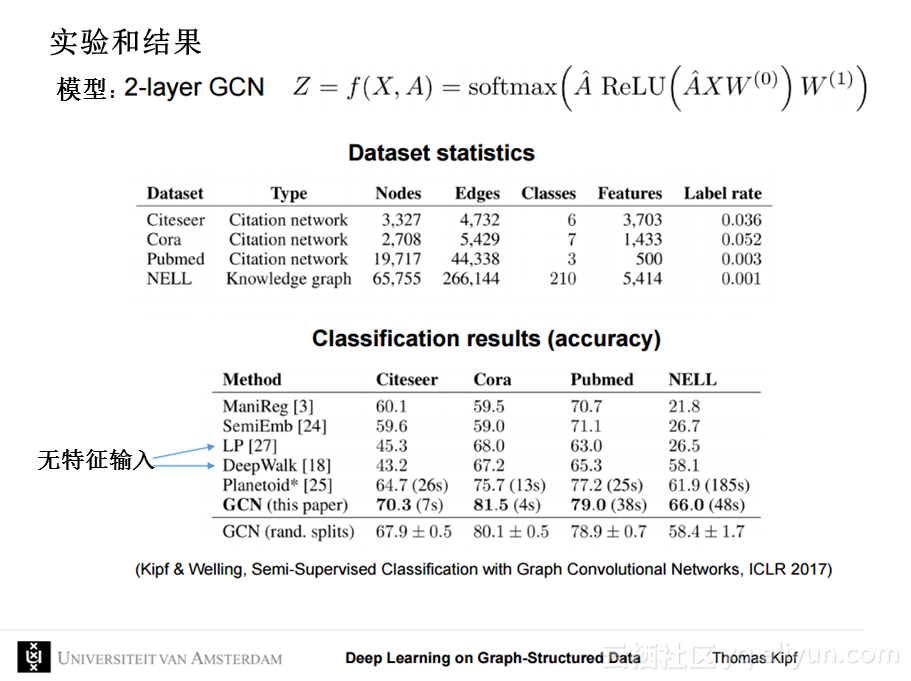

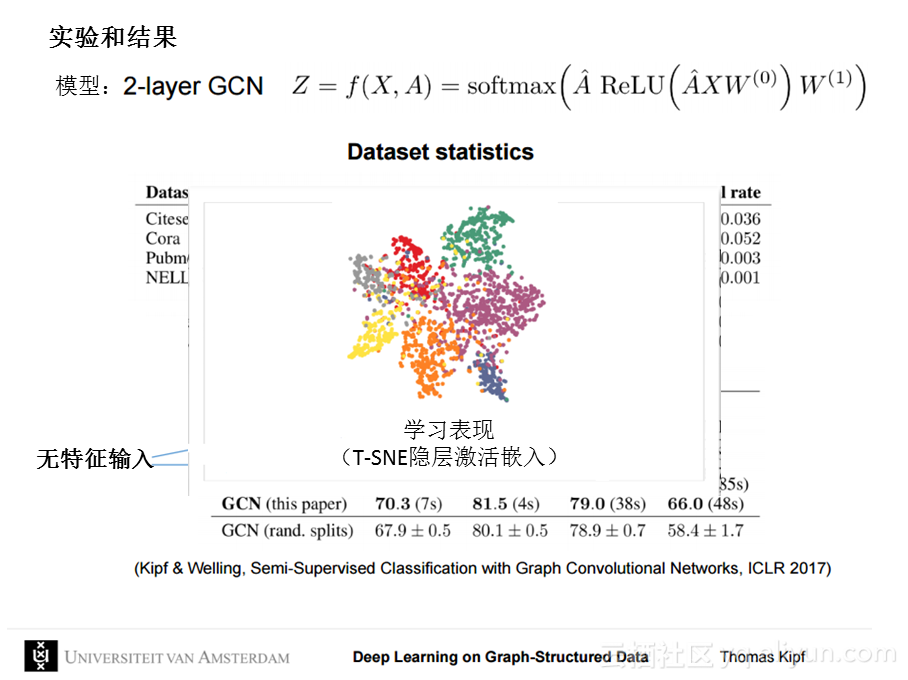

视频:此外,还有关于引文网络的分类,也可以 通过这个方法实现。 下面2-layerGCN模型的实验结果

下面2-layerGCN模型的实验结果

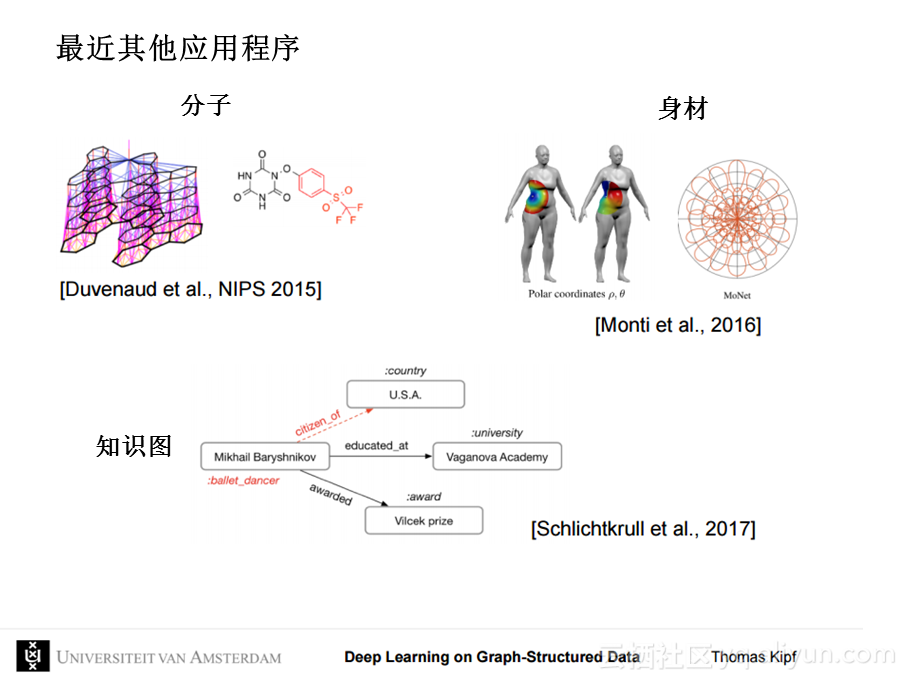

还要一些这个方法最近应用到其他程序的案例。

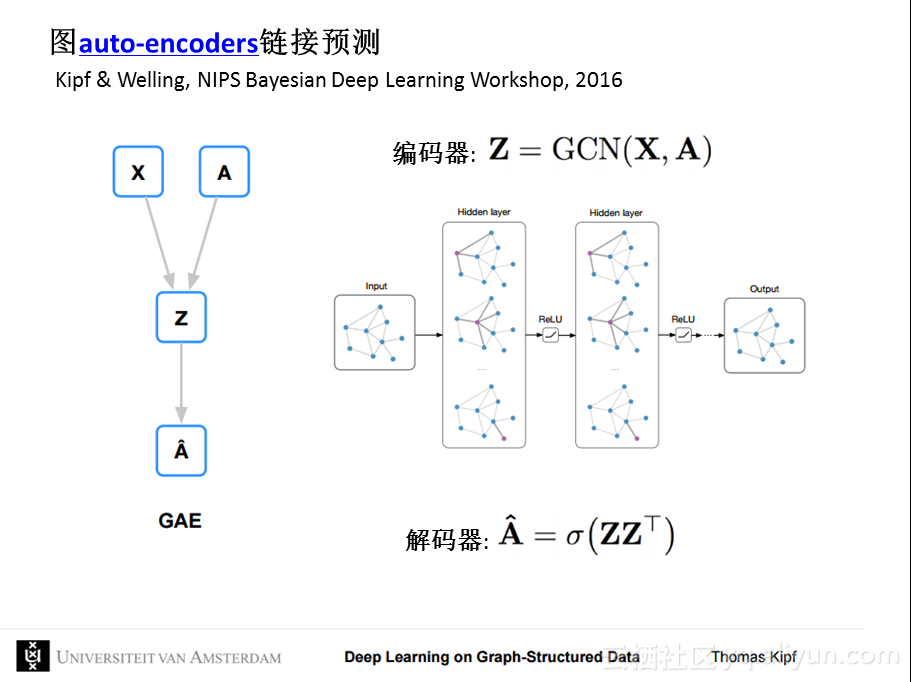

还要一些这个方法最近应用到其他程序的案例。 用这个方法关于图auto-encoders链接的预测。下面是auto-encoders的介绍

用这个方法关于图auto-encoders链接的预测。下面是auto-encoders的介绍

**进一步的阅读**

Blog post Graph Convolutional Networks:

Code on Github: Kipf & Welling, Semi-Supervised Classification with Graph Convolutional Networks, ICLR 2017: Kipf & Welling, Variational Graph Auto-Encoders, NIPS BDL Workshop, 2016: 作者:Thomas Kipf本文由北邮推荐,翻译。

作者:Thomas Kipf本文由北邮推荐,翻译。 文章原标题《Deep Learning on Graphs with Graph Convolutional Networks》,作者:Thomas Kipf,译者:袁虎,审阅:我是主题曲哥哥,附件为原文的pdf。

文章为简译,更为详细的内容,请查看转载地址:http://bafnx.baihongyu.com/

你可能感兴趣的文章

Java实现简单的文件复制

查看>>

less学习笔记

查看>>

redis缓存分页数据ID

查看>>

BitNami一键安装Redmine(转)

查看>>

QUdpSocket Class

查看>>

关于keil 5 下载或Debug后崩溃的问题

查看>>

BHO启动IE调试

查看>>

SpringBoot入门

查看>>

中文词频统计及词云制作

查看>>

最短作业优先

查看>>

MicroPython教程之TPYBoard v102 CAN总线通信

查看>>

shell脚本批量杀死进程

查看>>

团队编程

查看>>

POJ 1066--Treasure Hunt(判断线段相交)

查看>>

洛谷 P3317 [SDOI2014]重建(矩阵树定理+数学推导) [bzoj3534]

查看>>

区间dp - 不连续的回文串

查看>>

简单 hash 入门题目

查看>>

vue-cli之webpack的proxyTable无效的解决方案

查看>>

[转]Windows Server 2012 和 System Center 2012 SP1,Virtual Machine Manager 中启用的软件定义的网络...

查看>>

通过举例了解java中的流

查看>>